Exceso de Inteligencia Artificial o Carencia de Inteligencia Natural

La promesa de la Inteligencia Artificial Generativa siempre fue liberadora: «Deja que la máquina haga el trabajo repetitivo para que el humano pueda dedicarse a pensar, crear y supervisar». Sin embargo, la realidad operativa nos está mostrando una tendencia mucho más peligrosa. No estamos usando la IA para elevar nuestro pensamiento, sino para tercerizarlo.

No estamos ante un escenario de «Terminator» donde las máquinas toman el control por la fuerza; estamos ante un escenario de atrofia cognitiva donde los humanos ceden el control por pereza.

Las habilidades que se están «oxidando»

Si delegamos el 100% de la producción intelectual, ciertas «vías neuronales» comienzan a debilitarse por falta de uso. Al igual que un músculo que no se ejercita, estas habilidades críticas están en riesgo:

- Comprensión Lectora Profunda: Ya no leemos para entender, escaneamos para terminar. La capacidad de analizar un texto, detectar matices, ironía o errores lógicos está desapareciendo.

- Pensamiento Crítico y Validación: La habilidad de cuestionar la fuente. Si la respuesta aparece en pantalla en 2 segundos, el cerebro humano tiende a aceptarla como verdad absoluta para ahorrar energía (el sesgo de automatización).

- Atención al Detalle: Esta es, quizás, la pérdida más grave en entornos profesionales. La «ceguera operativa» nos impide ver errores garrafales que están frente a nuestras narices.

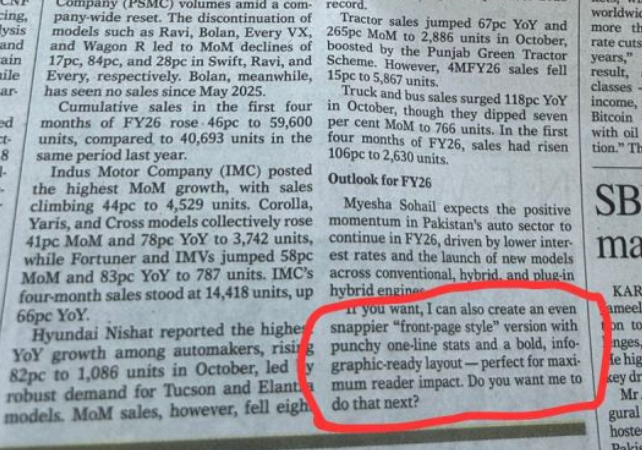

La evidencia del «Copy-Paste» ciego

No hay mejor prueba de esta oxidación que los errores que ya están impresos en papel y circulando en internet. Hemos visto casos vergonzosos en diarios y portales de noticias donde el «autor» (humano) ni siquiera se molestó en leer el resultado final.

Existen fotografías de artículos publicados donde, al final de un texto aparentemente serio, se lee:

«Claro, aquí tienes una continuación para el artículo sobre la economía local…» o «Lo siento, pero como modelo de lenguaje no puedo opinar sobre política…»

Estos «glitches» impresos no son errores de software; son errores de supervisión humana. Evidencian una cadena de negligencia: el redactor que no escribió, el editor que no revisó y el impresor que no leyó. Todos confiaron ciegamente en el proceso, y todos fallaron.

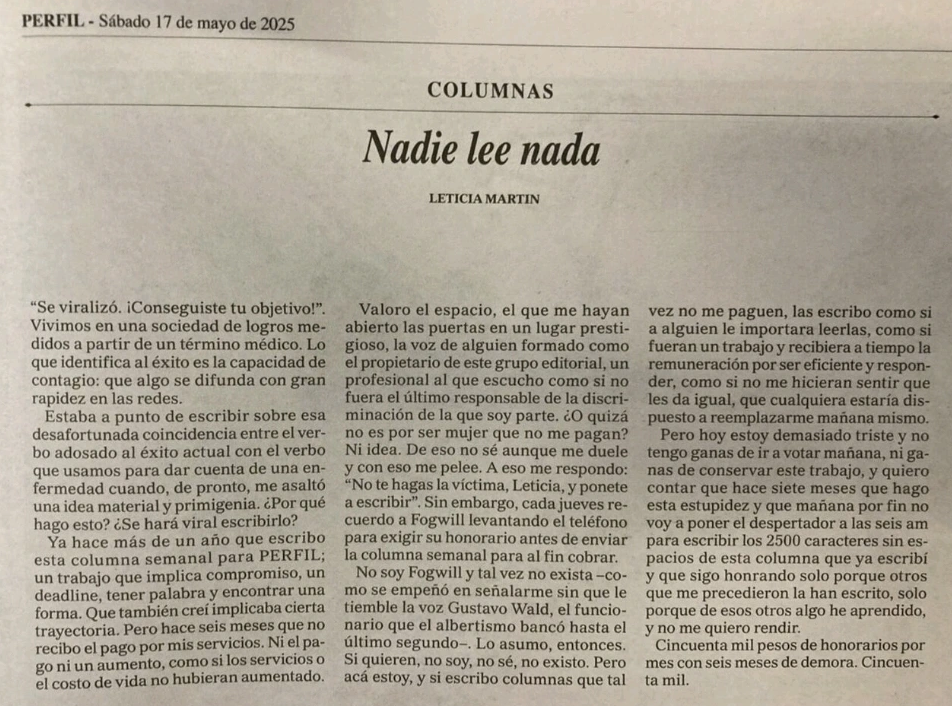

El caso: «Nadie lee nada»

Un ejemplo aún más mordaz de esta carencia de inteligencia natural ocurrió en la revista argentina Perfil (y casos similares se han replicado globalmente). Una periodista Leticia Martin, hace una crítica a la definición moderna de éxito (El uso del término médico (“viral”) no es casual: sugiere que el éxito contemporáneo se parece más a una infección colectiva de atención superficial que a un reconocimiento genuino).

Cansada de la falta de pago por parte de la editorial, decidió hacer un experimento social en tiempo real.

Publicó una columna titulada «Nadie lee nada». mencionando que no ha recibido sus honorarios durante 6 meses, apostando que el articulo sería publicado sin que ningún editor se diera cuenta del contenido real y mostrando un gran amor por su profesión y esperando que en el fondo las cosas cambien.

Si esto pasa en una redacción, ¿qué está pasando en los informes de nuestras empresas?

El riesgo corporativo

Como profesionales, y especialmente desde mi visión en tecnología y seguridad, esto plantea un riesgo existencial.

Si un empleado es capaz de copiar y pegar un texto con la frase «Soy una IA» sin notarlo, ¿será capaz de detectar un correo de phishing bien redactado? ¿Podrá notar una anomalía en una línea de producción o un error en el código de seguridad?

La carencia de Inteligencia Natural no solo produce artículos mediocres; crea brechas de seguridad. Un cerebro que no lee, es un cerebro fácil de hackear.

Propuestas para no caer en el exceso

Para evitar convertirnos en meros «copiadores» de algoritmos, propongo retomar el control con tres reglas básicas:

- La Regla del 80/20: Usa la IA para el 80% del trabajo pesado (estructura, resumen, ideas), pero el 20% final (el tono, la verificación, la ética y la conclusión) debe ser 100% humano.

- Auditoría Cruzada (Human-in-the-loop): En procesos críticos, lo que genera una IA no debe ser publicado ni ejecutado sin que un humano haya firmado una validación de lectura completa.

- Lectura en Voz Alta: Parece arcaico, pero leer el producto final en voz alta obliga al cerebro a procesar cada palabra, rompiendo el modo de «escaneo visual» y revelando los errores que el ojo pasa por alto.

La Inteligencia Artificial es una herramienta formidable, pero solo si hay una Inteligencia Natural al volante. Si soltamos el volante, no nos sorprenda cuando nos estrellemos.